OpenAI再度回歸“開放”賽道,一場精心布局的陽謀

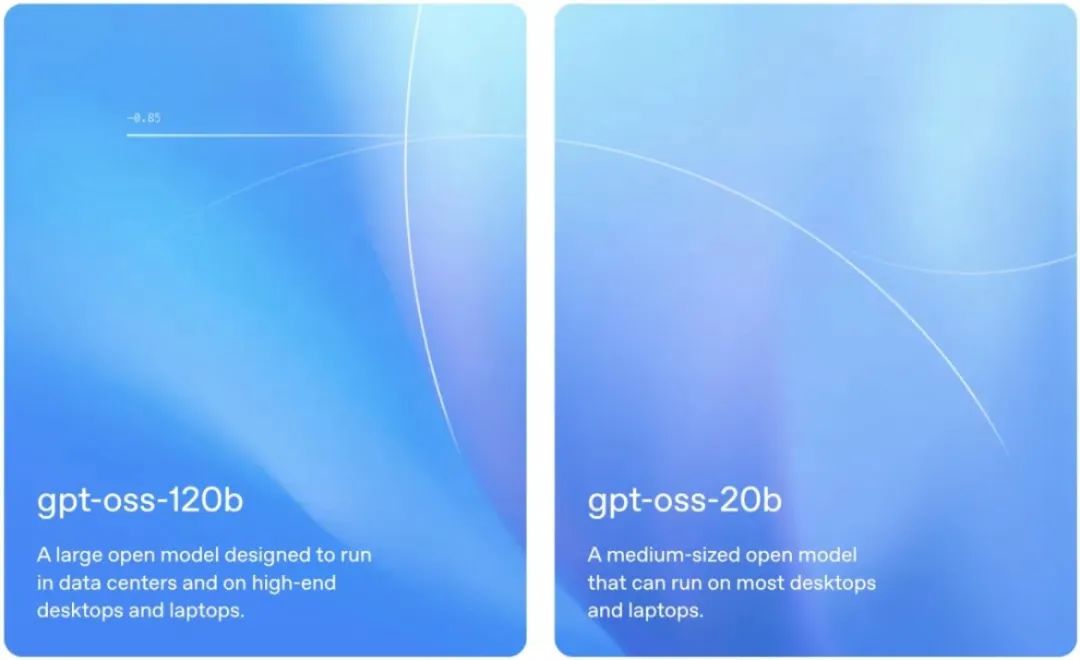

8月6日凌晨(美東時間8月5日),OpenAI發布了兩款免費試用的開放權重語言模型gpt-oss-120b和gpt-oss-20b,同時放出的34頁技術報告顯示模型采用了最先進的預訓練和后訓練技術,但沒有提供用于訓練模型的數據。

OpenAI聯合創始人兼首席執行官山姆·奧特曼(Sam Altman)在社交媒體表示:“gpt-oss是一個重大突破,這是最先進的開放權重推理模型,具有與o4-mini相當的強大現實世界性能,可以在你自己的電腦(或手機的較小版本)上本地運行。我們相信這是世界上最好、最實用的開放模型。”

gpt-oss系模型是OpenAI自2019年GPT-2后,時隔六年再度回歸“開放”賽道,也是OpenAI與微軟簽署獨家云服務協議六年來問世的首批此類模型。不僅讓普通開發者能用個人設備玩轉高級AI,更給白熱化的開源大模型競爭添了一把火。

· gpt-oss-120b:1170億參數,每token激活51億參數,單張GPU即可運行,適合中小型企業的專業級任務。在核心推理基準測試中,120B模型的表現與OpenAI o4-mini相當,并且能在單張80GB顯存的GPU上高效運行(如H100)。

· gpt-oss-20b:210億參數,每token激活36億參數,適用于低延遲、本地或專業化場景。在常用基準測試中,20B模型的表現與OpenAI o3-mini類似,并且能在僅有16GB顯存的邊緣設備上運行。

與API中的OpenAI o系列推理模型相似,gpt-oss兩款模型開源模型支持三種推理投入 —— 低、中、高,開發者只需在系統提示詞中加入一句話,即可在延遲與性能間靈活切換。除此之外,兩款模型在工具使用、少樣本函數調用、CoT推理以及HealthBench評測中也表現強勁,甚至比OpenAI的o1和GPT-4o等專有模型還要更強。不過,OpenAI暫未公布與DeepSeek-R1等競品的直接對比數據。

比肩旗艦o3/o4-mini

在多個基準測試中,gpt-oss-120b堪比旗艦級o系模型的性能。具體來說,在編程競賽(Codeforces)、通用問題解決(MMLU和HLE)以及工具調用(TauBench)方面,它直接超越了o3-mini,達到甚至超越了o4-mini的水平;在健康相關查詢(HealthBench?)、數學競賽(AIME 2024&2025)基準中,它的表現甚至優于o4-mini。

而盡管gpt-oss-20b規模較小,但在相同的評估中,其表現與o3-mini持平或更優,甚至在AIME、健康領域基準上的表現超越了o3-mini。

此外,它們都采用了Transformer架構并融入專家混合(MoE)設計,減少處理輸入時激活參數量。同時,gpt-oss模型在推理能力、效率以及在廣泛部署環境中的實用性上更強,借鑒了GPT-3設計理念,采用了交替的密集和局部帶狀稀疏注意力模式,支持高達128k的上下文長度。

· 支持微調:支持參數級微調,可根據您的特定用例對模型進行完全定制。

· 智能體能力:利用模型原生的函數調用、網頁瀏覽、Python代碼執行和結構化輸出等能力。

· 原生MXFP4量化:在訓練時,模型的混合專家(MoE)層便采用了原生的MXFP4精度,使得gpt-oss-120b在單張H100 GPU上即可運行,而gpt-oss-20b僅需16GB內存。

OpenAI近期研究表明,未經直接監督訓練的CoT有助于發現模型潛在不當行為。同樣,遵循o1-preview?的設計原則,研究團隊并未對gpt-oss模型CoT直接監督,讓模型更加透明。

gpt-oss-120b和gpt-oss-20b的開源,標志著OpenAI終于在開源模型上邁出了重要一步,標志著AI行業的一個轉折點。健康的開放模型生態系統,是讓AI普及并惠及所有人的一個重要方面,更重要的是,模型開源降低了一些群體,比如新興市場、缺少算力小企業的準入門檻。

OpenAI聯合創始人格雷格?布羅克曼強調:“開放模型的獨特價值在于本地化部署:企業能在自家防火墻內、個人可在筆記本上運行,數據隱私和安全更可控。”不過,此次發布的gpt-oss-120b和gpt-oss-20b,核心亮點是“開放權重”(open-weight),而不是我們更熟悉的“開源”。開放權重模型僅公開訓練好的“參數權重”(相當于模型的知識儲備),開發者可直接用這些權重微調模型,無需原始訓練數據;而開源(open-source)模型會公開完整代碼、訓練數據和方法論,開放程度更高。

OpenAI為何選擇“回歸”?

OpenAI此次發布開放權重模型很大程度上受到市場競爭壓力驅動,特別是來自中國DeepSeek的挑戰 —— Sam Altman曾坦言在開源策略上“站在了歷史錯誤的一邊”,這次的發布正是對“錯誤”的一次高調修正。自2019年以來,OpenAI一直專注于通過API提供專有模型服務,而競爭對手紛紛推出開放權重替代方案,2024年的開源大模型賽道早已不是一家獨大:此前,Meta的Llama系列長期占據標桿地位;今年初,DeepSeek發布高性價比的DeepSeek-R1模型,打破壟斷。開發者有了更多、更便宜的選擇,OpenAI再不跟進,就要掉隊了。

而在最大的競爭對手之一Meta傳出可能因安全問題收縮開源投入的時候,OpenAI選擇此時入場,意圖非常明顯就是想要搶占開發者入口,用免費、強大的模型吸引海量開發者進入自家生態,培養用戶習慣,為未來更強大的閉源模型和服務鋪路。這不僅是一次簡單的產品發布,更像是一次重大的戰略轉向,它背后是來自競爭對手的壓力,更是一場精心布局的陽謀。

利好開發者的是,gpt-oss兩款模型與Responses API?兼容,專為智能體工作流打造,在指令遵循、工具使用、推理上極其強大。從“只能用云服務”到“裝進背包隨時跑”,OpenAI這步棋不僅讓AI更親民,更可能倒逼整個行業向「輕量化、本地化」加速進化。

幾乎同步,亞馬遜宣布這兩款模型已登陸AWS的Bedrock生成式AI市場,這是OpenAI模型首次入駐該平臺,但雙方未披露具體合作條款;微軟也將GPU優化版本的gpt-oss-20b模型引入Windows設備。此次開放模型的發布可以視為OpenAI構建開放生態的關鍵一步:既降低開發者門檻,又能通過AWS等平臺擴大影響力,最終在商業化與技術普及間找到平衡。

評論